Современные технологии искусственного интеллекта (ИИ) поставили под сомнение эффективность привычных инструментов защиты от ботов в интернете. Прохождение тестов капчи (Captcha), созданные для того, чтобы отличать людей от машин, больше не справляются с этой задачей, утверждает издание The Conversation. Сегодня боты способны решать эти головоломки быстрее и точнее, чем люди.

Капча, появившаяся в начале 2000-х годов, была изобретена учёными из Университета Карнеги-Меллон. Изначально она была разработана для защиты сайтов от автоматизированных программ — ботов, которые создавали фальшивые аккаунты или, например, скупали билеты и распространяли спам. Принцип работы был очень прост: человек должен был выполнить задание, которое легко для людей, но сложно для машин.

Первая версия капчи предлагала пользователям вводить буквы и цифры. Позже, в 2007 году, появилась ReCaptcha, где к задачам добавились слова. В 2014 году Google выпустила ReCaptcha v2, которая до сих пор остаётся самой популярной. Она предлагает либо отметить галочку «Я не робот», либо выбрать верные изображения, например, с велосипедами или светофорами.

Однако ИИ-системы научились капчу обходить. Технологии компьютерного зрения и обработки языка позволяют машинам с лёгкостью «читать» искажённый текст и распознавать объекты на изображениях. Например, ИИ-инструменты, такие как Google Vision и OpenAI Clip, решают подобные задачи за доли секунды, тогда как человеку требуется гораздо больше времени. И это уже становится проблемой в реальной жизни. Боты используются для скупки билетов на спортивные матчи или массового бронирования мест, лишая тем самым доступа к покупке билетов обычных пользователей. Например, в Великобритании автоматизированные программы массово резервируют места на экзамены по вождению, чтобы затем их перепродавать с большой наценкой.

Тем не менее, разработчики пытаются адаптироваться к новым вызовам. Так, в 2018 году Google представила ReCaptcha v3, которая больше не требует от пользователей решать головоломки. Вместо этого система анализирует поведение на сайте — движение курсора, скорость набора текста и другие детали, характерные только для человека.

Однако выяснилось, что и такие методы не идеальны. Во-первых, они вызывают вопросы о конфиденциальности данных, так как требуют сбора информации о пользователях. Например, некоторые сайты уже начали использовать биометрические данные для проверки пользователей, такие как отпечатки пальцев, голосовые команды или идентификацию по лицу.

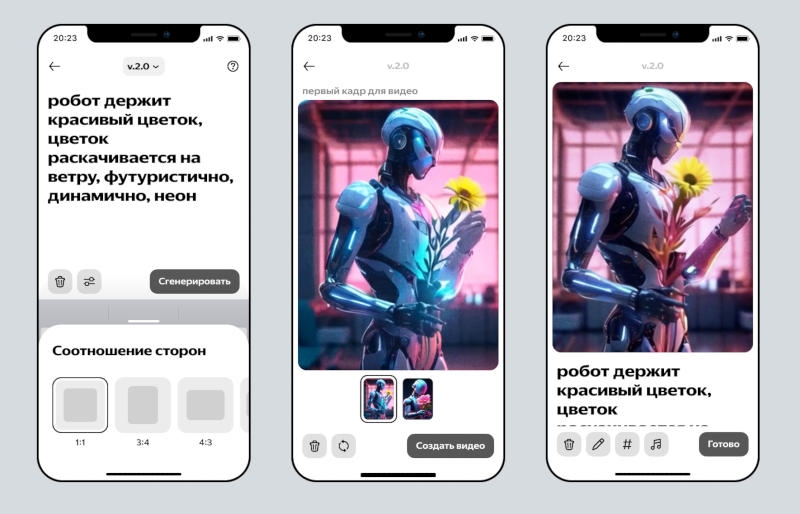

Во-вторых, даже эти системы уже могут обходиться продвинутыми ИИ, а с появлением ИИ-агентов — программ, которые будут выполнять задачи от имени пользователей, ситуация может усложниться ещё больше. В будущем сайтам потребуется различать «хороших» ботов, работающих на благо пользователей, и «плохих», которые нарушают правила. Одним из возможных решений может стать введение цифровых сертификатов для аутентификации, но пока они находятся на стадии разработки.

То есть, борьба между ботами и системами защиты продолжается. Captcha, которая когда-то была надёжным инструментом, теряет свою эффективность, а разработчикам предстоит найти новые способы защиты, которые будут одновременно удобными для пользователей и недоступными для злоумышленников.